Es común leer publicaciones que especulan sobre cómo la inteligencia artificial afectará distintos aspectos de la vida en el futuro, pero la realidad es que el uso de la inteligencia artificial ya es un hecho. Para dar contexto, el lanzamiento de ChatGPT (considerada la herramienta más comercial y accesible) fue en noviembre de 2022. Por lo tanto, es necesario dejar de especular y empezar a hablar de los cambios que ya estamos observando y estudiando.

En una encuesta publicada en mayo de 2024 por el equipo de economistas de LinkedIn, se reportó que el 75% de los empleados en el sector conocido como «economía del conocimiento» utilizan herramientas de IA generativa en su día a día. Los «knowledge workers» son profesionales cuyo trabajo principal implica manejar o utilizar información. Suelen trabajar con datos, analizarlos y aplicar conocimientos especializados para resolver problemas complejos. Estos trabajadores del conocimiento a menudo incluyen a ingenieros, médicos, abogados, científicos, reclutadores y especialistas en TI.

Esta estadística demuestra que la adopción de la IA en las empresas es innegable y está avanzando con paso firme. Sin embargo, para entender las verdaderas consecuencias de su implementación, debemos mirar más allá de la tecnología y centrarnos en las implicaciones que tiene sobre el comportamiento humano.

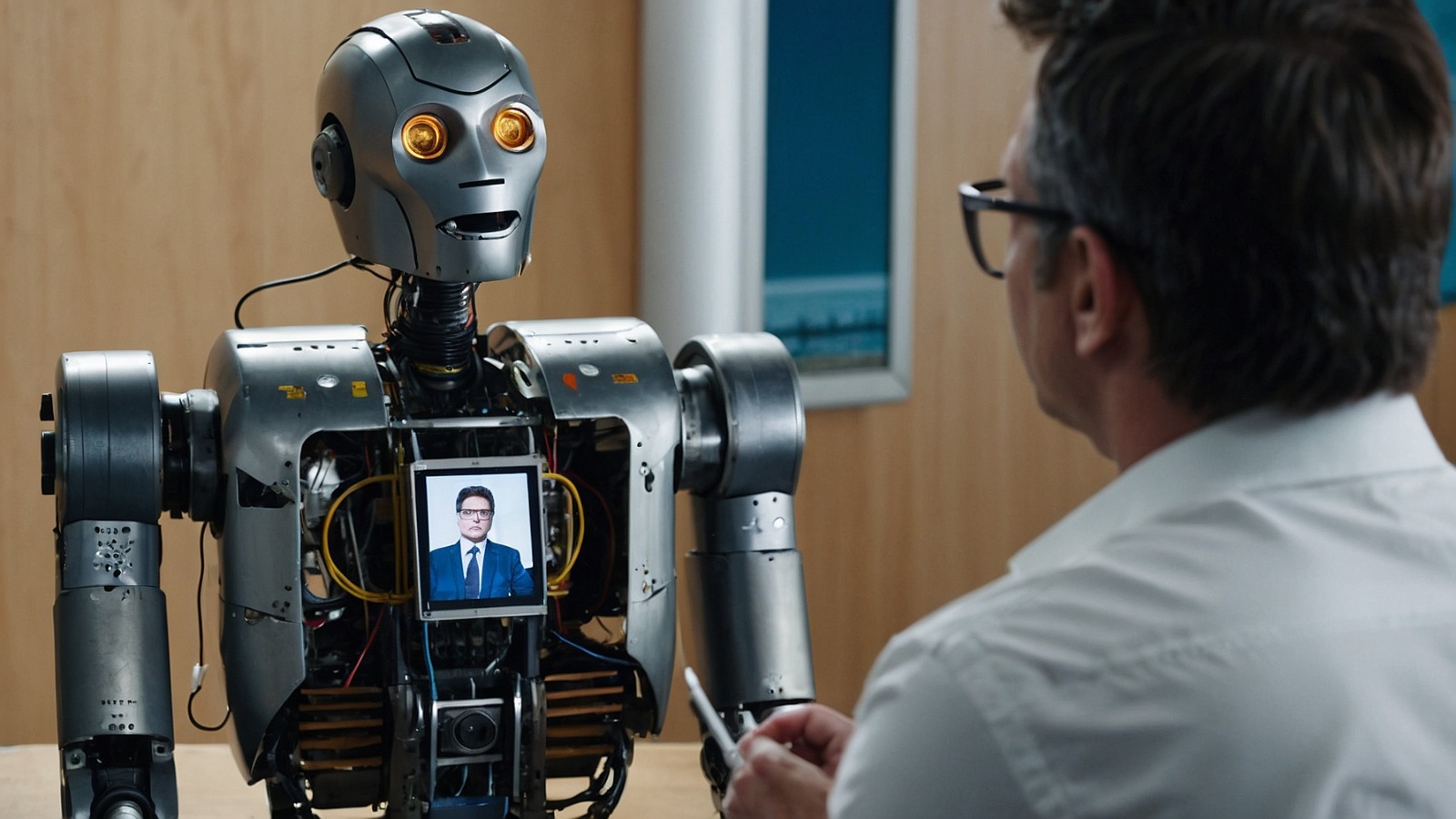

La Promesa y el Riesgo de la IA en la Selección de Talento

La promesa de la IA es clara: mayor eficiencia, menor carga de trabajo y decisiones basadas en datos. Esta promesa ha resultado muy atractiva para reclutadores y empresas de selección de talento que buscan automatizar tareas repetitivas, como el análisis de currículums y la evaluación de la experiencia de los candidatos. Esto suena como la solución ideal para mejorar la eficiencia en los procesos de selección, pero ¿podría esta misma tecnología estar llevando a más errores humanos?

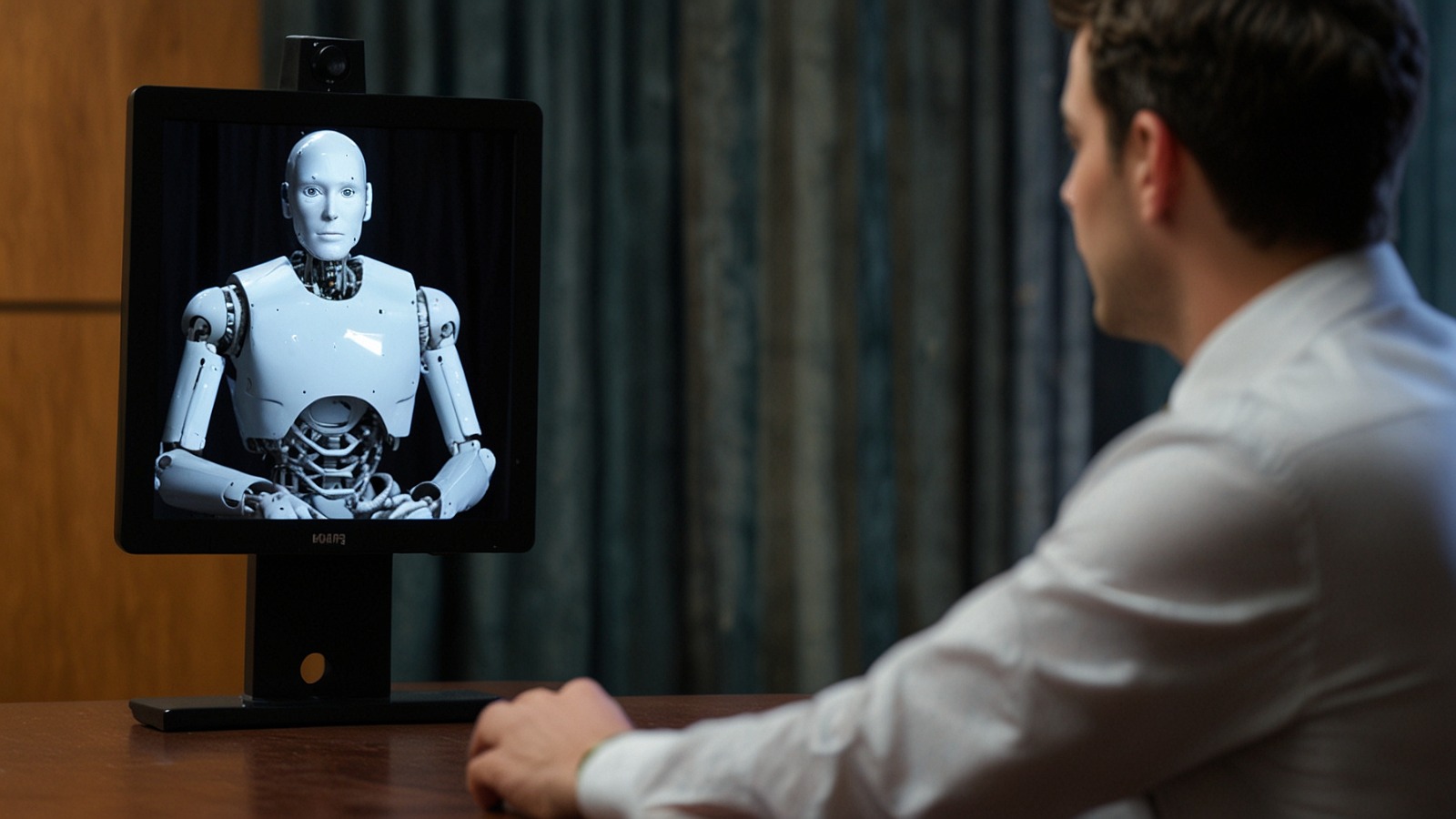

Estudios recientes, como el realizado en Harvard por Fabrizio Dell’Acqua, «Effects of AI on Knowledge Worker Productivity and Quality» revelan una inquietante tendencia: cuanto mayor es la percepción de la capacidad de la IA, mayor es la propensión de los reclutadores a cometer errores. Dell’Acqua contrató a 181 reclutadores profesionales y les asignó la tarea de evaluar 44 solicitudes de empleo basadas en la habilidad matemática de los candidatos, una habilidad que no era obvia en los currículums. Los reclutadores con una IA que consideraban de alta calidad, debido a la percepción generada por las respuestas que otorgaba, dedicaron menos tiempo y esfuerzo en cada currículum y siguieron ciegamente las recomendaciones de la IA. En contraste, aquellos que percibían la IA como de menor calidad, porque así fueron instruidos por los investigadores, fueron más críticos y mejoraron tanto su interacción con la IA como sus propias habilidades de evaluación.

La Paradoja de la IA en la economía del conocimiento

En otras palabras, Dell’Acqua demostró que los reclutadores que utilizaban una IA percibida como de alta calidad sustituyeron su juicio crítico por las respuestas obtenidas por la IA, volviéndose perezosos y menos críticos en sus evaluaciones. Al depender ciegamente de las recomendaciones de la IA, perdieron la capacidad de discernir y evaluar a los candidatos de manera independiente. Esto resultó en decisiones de contratación menos acertadas y en la pérdida de candidatos brillantes.

Su estudio resalta una paradoja intrigante: cuanto más creemos en la capacidad de la IA, mayor es la posibilidad de que cometamos errores. Este fenómeno subraya un problema fundamental en la colaboración entre humanos y máquinas: la dependencia excesiva en la IA puede llevar a la degradación de habilidades humanas cruciales.

Los Sesgos Cognitivos en el Uso de la IA

El problema no es solo de los reclutadores; todos los que utilizamos estas tecnologías caemos en la trampa de pensar que pueden resolver todos nuestros problemas y convertirnos en expertos instantáneamente. Pero si queremos que la IA sea un facilitador y no un obstáculo, debemos mantener nuestra capacidad crítica para evaluar la calidad real de la información. Aunque esto suene sencillo, existen sesgos mentales que, debido a la configuración evolutiva de nuestro cerebro, no nos permiten darnos cuenta de estos errores. Estos cinco sesgos son clave en cuanto al uso y apreciación que tenemos de la inteligencia artificial:

El sesgo de automatización se refiere a la tendencia de las personas a confiar y preferir decisiones y procesos automatizados en lugar de aquellos que requieren un juicio humano deliberado. Este sesgo se manifiesta especialmente en contextos donde se prefiere delegar la toma de decisiones a sistemas, asumiendo que estos son más eficientes y menos propensos a errores que los humanos. No se trata de volverse perezoso por desidia; el cerebro está programado para automatizar la mayor cantidad de procesos posibles y, de esta forma, ahorrar energía.

La ilusión de control nos lleva a creer que podemos influir en los resultados que arroja la IA más de lo que realmente podemos. A pesar de escribir prompts detallados, las respuestas de la IA dependen de datos y algoritmos predefinidos que no controlamos y que no conocemos. Aunque las respuestas sean extensas y bien estructuradas, discernir su veracidad y utilidad requiere un conocimiento profundo y una comprensión que solo los humanos pueden aportar.

El Efecto IKEA destaca nuestra tendencia a valorar más aquello en lo que hemos participado activamente, incluso si la calidad no es alta. Interactuar con una IA nos hace sentir que el resultado es valioso, pero esto no siempre refleja su calidad o exactitud. Reconocer y superar este sesgo es crucial para evaluar objetivamente el contenido generado por la IA.

Una vez que nos hemos acostumbrado a integrar la IA en nuestras actividades cotidianas, corremos el riesgo de caer en el Einstellung Bias o Efecto Einstellung, un sesgo cognitivo que describe la tendencia a recurrir a soluciones conocidas y familiares para resolver problemas, incluso cuando existen alternativas más eficientes o efectivas. Este término, que proviene del alemán «Einstellung», significa «configuración» o «actitud». Ilustra cómo una solución previamente aprendida puede obstaculizar nuestra capacidad para considerar otros enfoques o métodos.

Finalmente, el sesgo de facilidad de procesamiento muestra cómo tendemos a creer que algo es correcto simplemente porque es fácil de entender. Las respuestas de la IA están diseñadas para ser fluidas y comprensibles, lo que puede llevarnos a pensar que son más verdaderas. Aquí, la habilidad humana de cuestionar, analizar críticamente y buscar evidencias concretas se vuelve indispensable.

La Importancia del Juicio Crítico en el Uso de la IA

Retomando el caso de los reclutadores, pero extendiendo la consideración a todos los profesionales de la economía del conocimiento, es crucial establecer un equilibrio adecuado en el uso de la IA en los procesos de selección de talento. La IA debería ser vista como una herramienta que complementa y enriquece las habilidades humanas, y no como un sustituto total. Es importante recordar que, debido a nuestros sesgos y la configuración de nuestro cerebro, somos propensos a cometer errores, y cuanto más avanzada sea la IA, mayor será el riesgo de que los reclutadores confíen en ella ciegamente, lo que podría llevar a errores significativos. La clave está en emplear la IA como una herramienta complementaria, manteniendo siempre el juicio crítico humano en el proceso, para asegurarnos de tomar las mejores decisiones posibles en la selección de talentos.

Si disfrutaste este artículo o quieres obtener contenido especial puedes suscribirte a nuestro Newsletter en el que compartimos consejos prácticos y aplicados de Behavioral Science a negocios parar lograr mejores resultados financieros. Puedes seguir seguir la página de Disruptech en Linkedin o mi perfil personal Guillermo Ponce. Espero verte cada semana y que el contenido que comparta te ayude a mejorar los resultados de tu empresa, saludos!